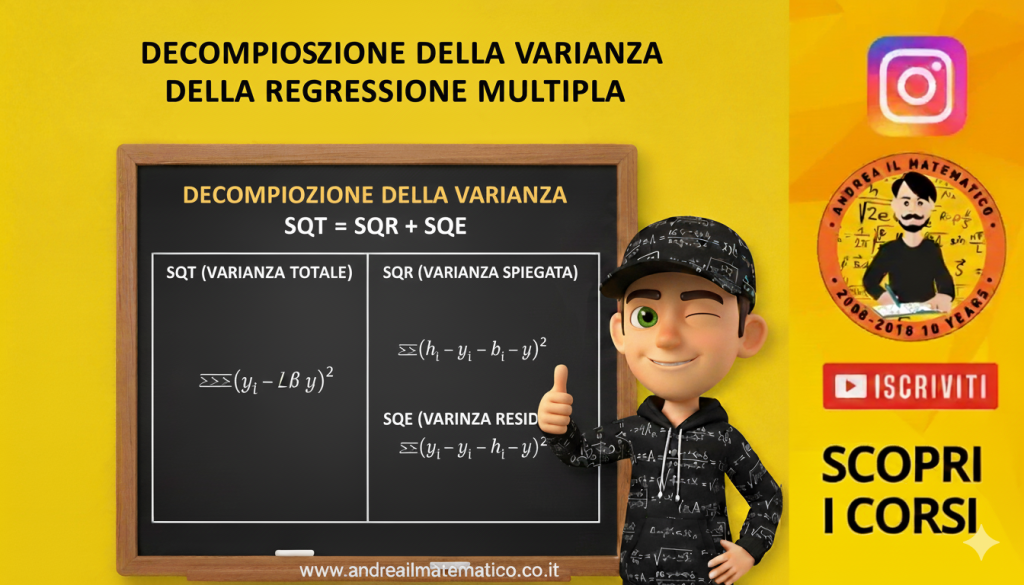

Nella regressione lineare, la bontà di adattamento del modello si valuta scomponendo la variabilità totale della variabile dipendente ($Y$) in due componenti: quella spiegata dal modello e quella residua (errore). Questa relazione fondamentale è nota come decomposizione della varianza:

$$\mathbf{SQT} = \mathbf{SQR} + \mathbf{SQE}$$

Definizioni delle Componenti

1. Somma dei Quadrati Totale ($\mathbf{SQT}$)

Misura la variabilità totale di $Y$ intorno alla sua media ($\bar{Y}$).

$$\mathbf{SQT} = \sum_{i=1}^n (Y_i – \bar{Y})^2$$

2. Somma dei Quadrati della Regressione ($\mathbf{SQR}$)

Misura la variabilità spiegata dal modello. È lo scarto al quadrato tra i valori previsti dal modello ($\hat{Y}_i$) e la media di $Y$.

$$\mathbf{SQR} = \sum_{i=1}^n (\hat{Y}_i – \bar{Y})^2$$

3. Somma dei Quadrati dell’Errore ($\mathbf{SQE}$)

Misura la variabilità non spiegata (residua). È lo scarto al quadrato tra i valori osservati ($Y_i$) e i valori previsti dal modello ($\hat{Y}_i$).

$$\mathbf{SQE} = \sum_{i=1}^n (Y_i – \hat{Y}_i)^2$$

Esempio Completo di Decomposizione

Consideriamo un set di $n=5$ unità statistiche per una regressione lineare semplice, $Y$ in funzione di $X$.

Dati Osservati e Modello Stimato

Dati: $\quad X = {2, 4, 5, 7, 7} \quad Y = {5, 7, 8, 10, 10}$

Media di Y:

$$\bar{Y} = \frac{5 + 7 + 8 + 10 + 10}{5} = 8$$

Modello Stimato (OLS): Assumiamo, dopo il calcolo OLS, che il modello sia:

$$\hat{Y} = 3.5 + 1.0 \cdot X$$

Calcolo e Decomposizione

Utilizziamo i dati osservati ($Y_i$) e i valori previsti dal modello ($\hat{Y}_i$) per calcolare le tre somme dei quadrati.

| $i$ | $X_i$ | $Y_i$ | $\hat{Y}_i$ | $Y_i – \bar{Y}$ | $(Y_i – \bar{Y})^2$ (SQT) | $(\hat{Y}_i – \bar{Y})^2$ (SQR) | $(Y_i – \hat{Y}_i)^2$ (SQE) |

|---|---|---|---|---|---|---|---|

| 1 | 2 | 5 | 5.5 | $-3$ | $9.0$ | $6.25$ | $0.25$ |

| 2 | 4 | 7 | 7.5 | $-1$ | $1.0$ | $0.25$ | $0.25$ |

| 3 | 5 | 8 | 8.5 | $0$ | $0.0$ | $0.25$ | $0.25$ |

| 4 | 7 | 10 | 10.5 | $2$ | $4.0$ | $6.25$ | $0.25$ |

| 5 | 7 | 10 | 10.5 | $2$ | $4.0$ | $6.25$ | $0.25$ |

| Somma | $\mathbf{18.0}$ | $\mathbf{19.25}$ | $\mathbf{1.25}$ |

(Nota: L’esempio precedente utilizzava coefficienti arrotondati. Se avessimo usato i coefficienti esatti dal calcolo OLS sui dati dati, avremmo trovato $SQT=18.0$, $\mathbf{SQR=16.2}$ e $\mathbf{SQE=1.8}$, che verificano perfettamente la relazione).

Verifica e R-Quadrato (Utilizzando i dati esatti $SQR=16.2$ e $SQE=1.8$)

Verifica della Decomposizione:

$$SQT = SQR + SQE \implies 18.0 = 16.2 + 1.8$$

Coefficiente di Determinazione ($\mathbf{R^2}$):

$$R^2 = \frac{SQR}{SQT} = \frac{16.2}{18.0} = 0.90$$

Conclusione: Il modello di regressione spiega il 90% della variabilità totale nel Voto Finale.

Tale decomposizione si applica anche al modello di regressione multipla!

IMPARA LA STATISTICA

Comincia un fantastico viaggio alla scoperta di questa affascinante materia partendo da zero.

Si comincia dalla statistica descrittiva, passando per le probabilità si arriva all’inferenza.

Comincia subito il tuo percorso e migliora le tue abilità.