Piani e iperpiani nello spazio: equazione parametrica e cartesiana

Nello studio della geometria analitica, capire come rappresentare piani e iperpiani nello spazio è il passo naturale successivo dopo aver analizzato le rette. Un piano

Nello studio della geometria analitica, capire come rappresentare piani e iperpiani nello spazio è il passo naturale successivo dopo aver analizzato le rette. Un piano

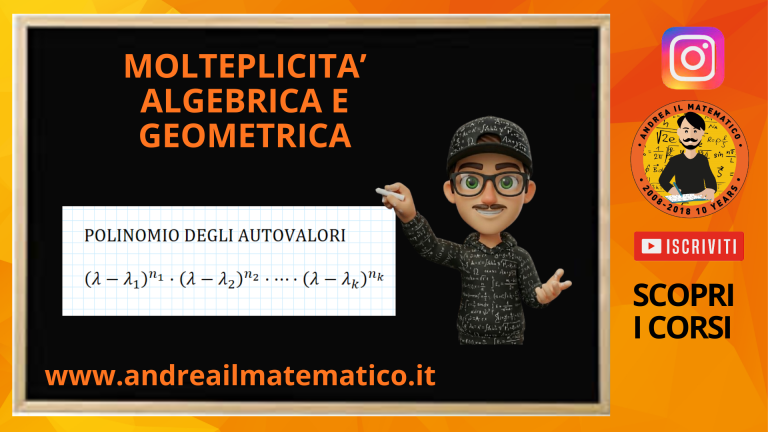

Quando studiamo la diagonalizzazione di una matrice, capire la differenza tra la molteplicità algebrica e geometrica è il passaggio fondamentale per stabilire se la matrice

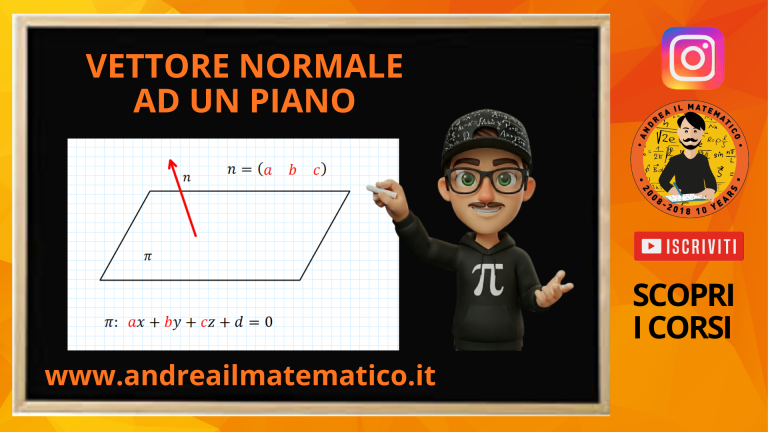

In geometria analitica, il vettore normale ad un piano o iperpiano è un vettore non nullo che risulta perpendicolare (ortogonale) a ogni vettore giacente sulla

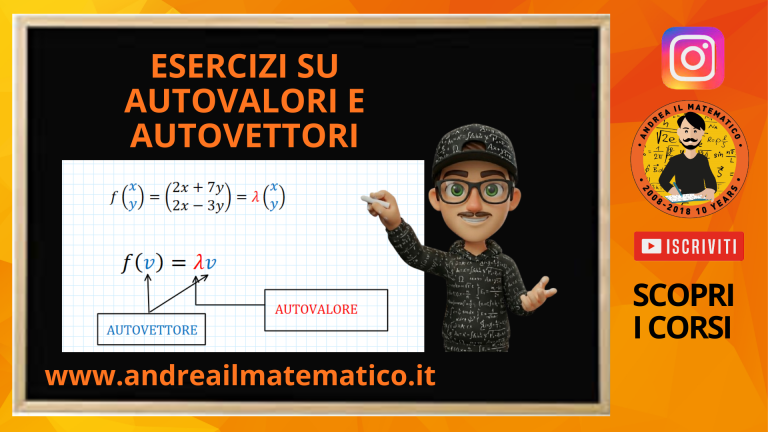

Dopo aver compreso la teoria, il modo migliore per padroneggiare l’algebra lineare è mettersi alla prova con esercizi su autovalori e autovettori. Questi problemi sono

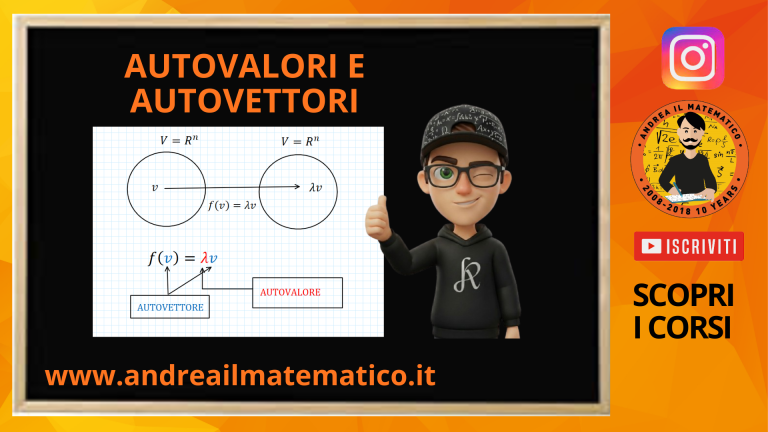

Nello studio delle trasformazioni lineari, i concetti di autovalori e autovettori sono tra i più potenti e utilizzati. Essi ci permettono di individuare le direzioni

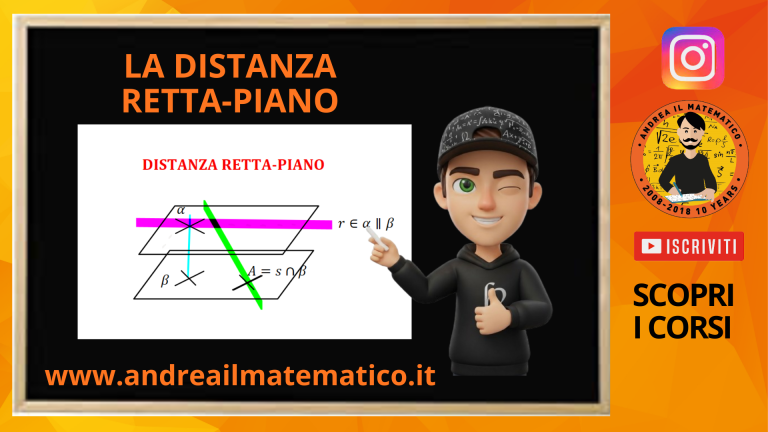

Nel calcolo geometrico tridimensionale, determinare la distanza di una retta da un piano è un problema che si riconduce spesso a casi più semplici. Questa

Capire la posizione tra due piani è un passaggio fondamentale della geometria analitica nello spazio, poiché ci permette di stabilire se due superfici piane sono

Nello studio della geometria analitica dello spazio, analizzare la posizione tra una retta e un piano significa stabilire se essi si intersecano in un punto,

Capire come rappresentare la retta nello spazio è fondamentale in algebra lineare e geometria analitica, poiché ci permette di descrivere traiettorie e intersezioni in tre

Determinare la posizione di due rette nello spazio significa stabilire se esse giacciono sullo stesso piano (complanari) o meno, e in che modo interagiscono tra

Se c’è un momento in cui l’Algebra Lineare smette di essere teoria e ti colpisce con la sua utilità, è quando la usi per risolvere

In ogni videogioco c’è un Boss Finale. Quel nemico più grande, più cattivo e più difficile di tutti gli altri, che devi battere per finire

Se c’è un nome che incute timore in un esame di Algebra Lineare, è Rouché-Capelli. Sembra un incantesimo, una formula complessa fatta apposta per confondere.

Se sei una matricola di Ingegneria, Informatica, Matematica o Economia, c’è un esame che probabilmente ti sta guardando storto dal libretto. Non è Analisi. È

Se parli con uno studente di Ingegneria e uno di Economia che stanno preparando lo stesso esame, l’esame di Algebra Lineare, ti sembrerà che stiano

Se stai affrontando questa materia, sai benissimo di cosa stiamo parlando. L’Algebra Lineare non è difficile come la matematica delle superiori. È difficile in un

Hai studiato le definizioni, hai provato a capire i concetti e forse hai smesso di temere l’astrazione. Ottimo. Ma l’esame di Algebra Lineare è una

Il Metodo di Newton (o metodo di Newton-Raphson generalizzato) è l’approccio numerico iterativo più diffuso per la risoluzione delle Equazioni Polinomiali Matriciali (PME). A differenza

La Derivata di Fréchet è l’operatore, $\mathbf{F}'(\mathbf{X})[\mathbf{\Delta}]$, che definisce le derivate di funzioni matriciali per le matrici $\mathbf{X}$. A causa della non commutatività, l’operatore è

Le equazioni matriciali sono espressioni algebriche in cui l’incognita principale ($\mathbf{X}$) è una matrice. A differenza delle equazioni scalari, le soluzioni devono tenere conto della

Il calcolo del determinante a blocchi è un principio essenziale in algebra lineare, particolarmente rilevante nello studio dei sistemi dinamici e delle equazioni matriciali. Nel

Le equazioni matriciali di secondo grado (Quadratic Matrix Equations – QME) sono la classe più semplice e studiata di equazioni matriciali non lineari. Una singola

Il metodo più efficace per risolvere le equazioni matriciali di terzo grado (PME, Polynomial Matrix Equations) si fonda sulla linearizzazione, un principio identico a quello

Introduzione Il teorema dell’equivalenza GME-PME stabilisce il principio fondamentale per la risoluzione delle Equazioni Polinomiali Matriciali (PME), dimostrando l’identità tra due metodi di calcolo del

Il calcolo della potenza di una matrice, $\mathbf{A}^k$, è un’operazione fondamentale in molti campi, dalla risoluzione di sistemi di equazioni differenziali lineari alla modellizzazione dei

L’esponenziale di una matrice, $\mathbf{e}^{\mathbf{A}}$, estende la funzione scalare $e^x$ alle matrici quadrate ed è fondamentale per risolvere sistemi dinamici lineari. 1. Definizione: La Serie

Le equazioni matriciali di primo grado sono la forma più semplice e lineare di equazioni matriciali. L’algebra matriciale impone metodi di soluzione specifici a causa

Il Prodotto di Kronecker ($\otimes$), noto anche come prodotto tensoriale, è un’operazione che combina due matrici di dimensioni arbitrarie per produrne una più grande. È

L’operatore di vettorizzazione ($\text{vec}$) è un’operazione che trasforma una matrice in un lungo vettore colonna. Questa trasformazione è fondamentale per trattare le operazioni matriciali come

I VETTORI : DEFINIZIONE I vettori sono segmenti orientati che si trovano in un piano, nello spazio e addirittura nell’iperspazio. Sono utilizzati in fisica per descrivere grandezze che definiamo vettoriali che necessitano di una rappresentazione.