Le combinazioni lineari sono espressioni in cui compaiono somme di vettori moltiplicati per una costante.

La scrittura generale di una combinazione lineare è del tipo:

$$ \large\sum_{i=1}^n a_i v_i \\ \ \\ \begin{array}{l} \text{$a_i$ è un generico elemento di un campo $\mathbb{K}$} \\ \text{$v_i$ è un generico elemento di uno spazio vettoriale} \end{array} $$

Ricordiamo che un campo 𝕂 può essere ad esempio l’insieme dei numeri reali ℝ oppure l’insieme dei numeri complessi ℂ.

Un vettore, a sua volta può essere in senso più allargato un polinomio, una matrice oppure anche una funzione.

Lo spazio vettoriale è una struttura algebrica che indica l’insieme di tutti i vettori che partono dall’origine e che sono generati da un insieme di vettori linearmente indipendenti detta base dello spazio vettoriale.

Esplicitando la formula possiamo scrivere:

$$ \sum_{i=1}^n = a_1 v_1 + a_2 v_2 + \cdots + a_n v_n $$

Per poter effettuare una combinazione lineare i vettori o elementi devono necessariamente appartenere allo stesso spazio vettoriale, ovvero devono avere lo stesso numero di componenti

INDICE

- 1 COMBINAZIONI LINEARI DI VETTORI – ESEMPIO

- 2 COMBINAZIONI LINEARI CON LE MATRICI

- 3 COME RICONOSCERE UNA COMBINAZIONE LINEARE ?

- 4 ESEMPIO DI VETTORI LINEARMENTE INDIPENDENTI

- 5 STUDIO DELLA DIPENDENZA LINEARE CON IL RANGO

- 6 HAI QUALCHE DOMANDA ?

- 7 SCOPRI I SEGRETI DELL’ALGEBRA LINEARE

- 8 L’ARTICOLO TI è PIACIUTO ?

COMBINAZIONI LINEARI DI VETTORI – ESEMPIO

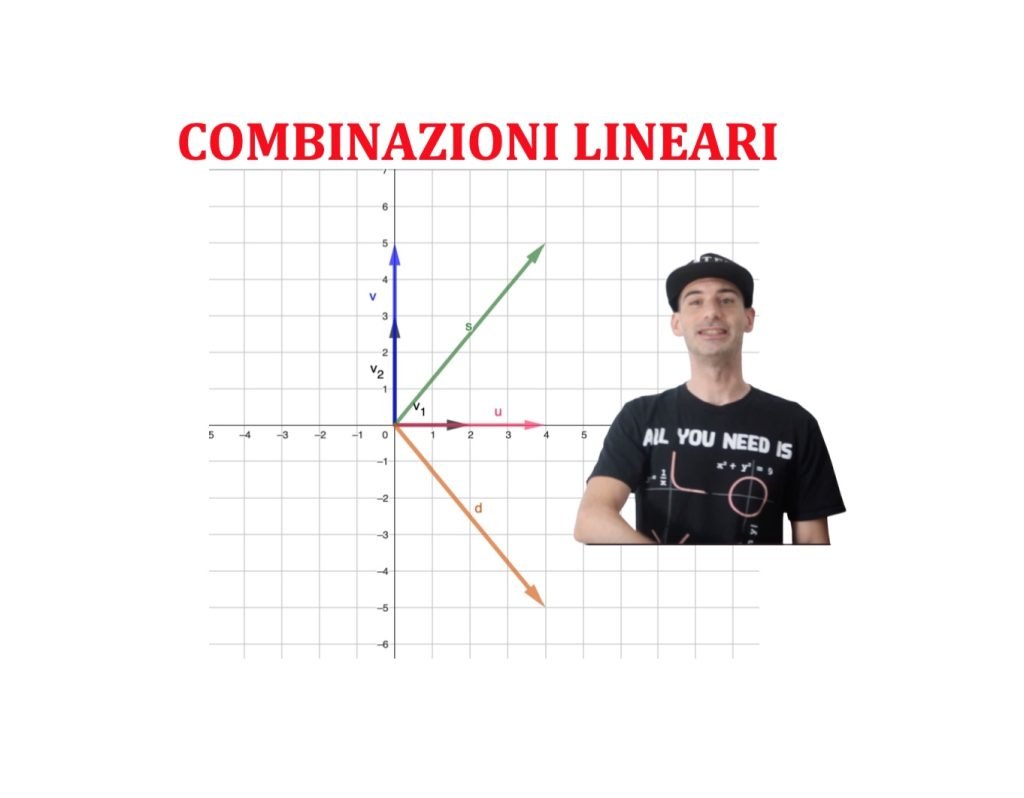

Consideriamo due vettori con specifiche coordinate:

$$ v_1 = \begin{pmatrix} 2\\0 \end{pmatrix} \quad v_2= \begin{pmatrix} 0\\3 \end{pmatrix} $$

e rappresentiamoli nel piano cartesiano:

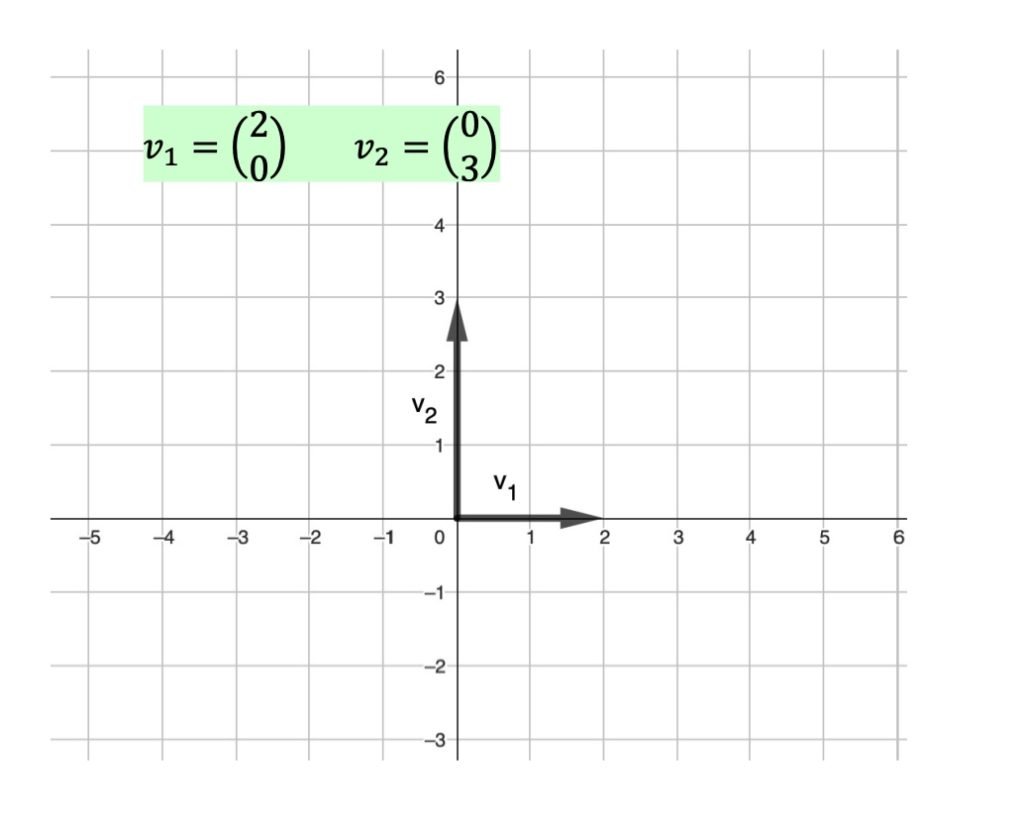

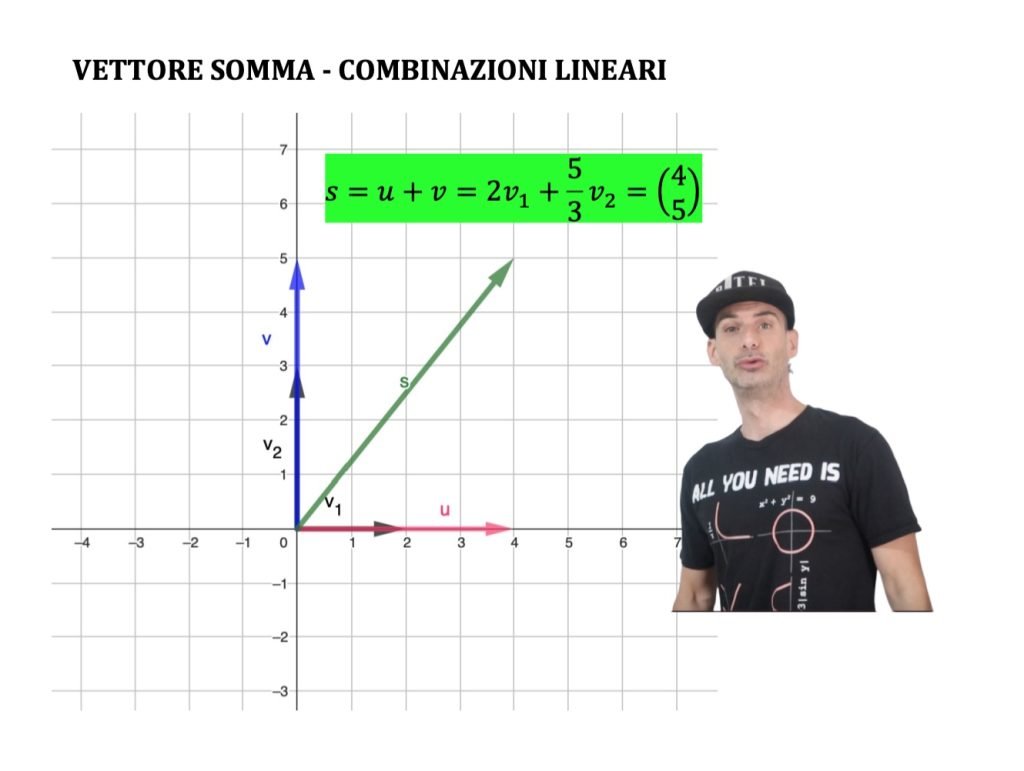

Ora facciamo le prime due combinazioni lineari creando i vettori u e v

$$ u= 2v_1 \quad \text{e} \quad v= \frac{5}{3} v_2 $$

Dunque applicando la definizione di moltiplicazione tra vettore e scalare scriviamo:

$$ \begin{array}{l} u= 2v_1 &=& 2 \begin{pmatrix} 2\\0 \end{pmatrix} = \begin{pmatrix} 2 \cdot 2 \\ 2 \cdot 0 \end{pmatrix} &=& \begin{pmatrix} 4\\0 \end{pmatrix} \\ v= \frac{5}{3} v_1 &=& \frac{5}{3} \begin{pmatrix} 0\\3 \end{pmatrix} = \begin{pmatrix} \frac{5}{3} \cdot 0 \\ \frac{5}{3} \cdot 3 \end{pmatrix} &=& \begin{pmatrix} 0\\5 \end{pmatrix} \end{array} $$

In questo caso possiamo affermare che il vettore u è una combinazione lineare del vettore v1 mentre il vettore v è una combinazione lineare del vettore v2 .

Un altro modo per dire questo è: i vettori u e w sono combinazioni lineari (o dipendono linearmente) rispettivamente dai vettori v1 e v2 .

Rappresentiamoli:

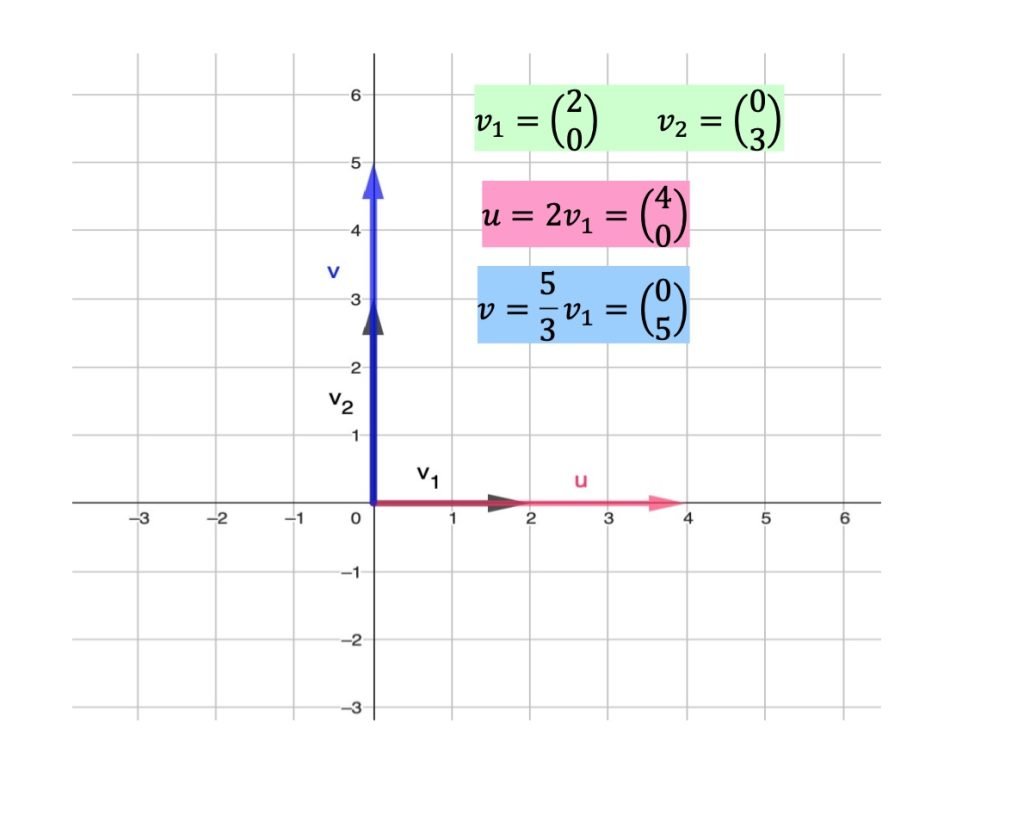

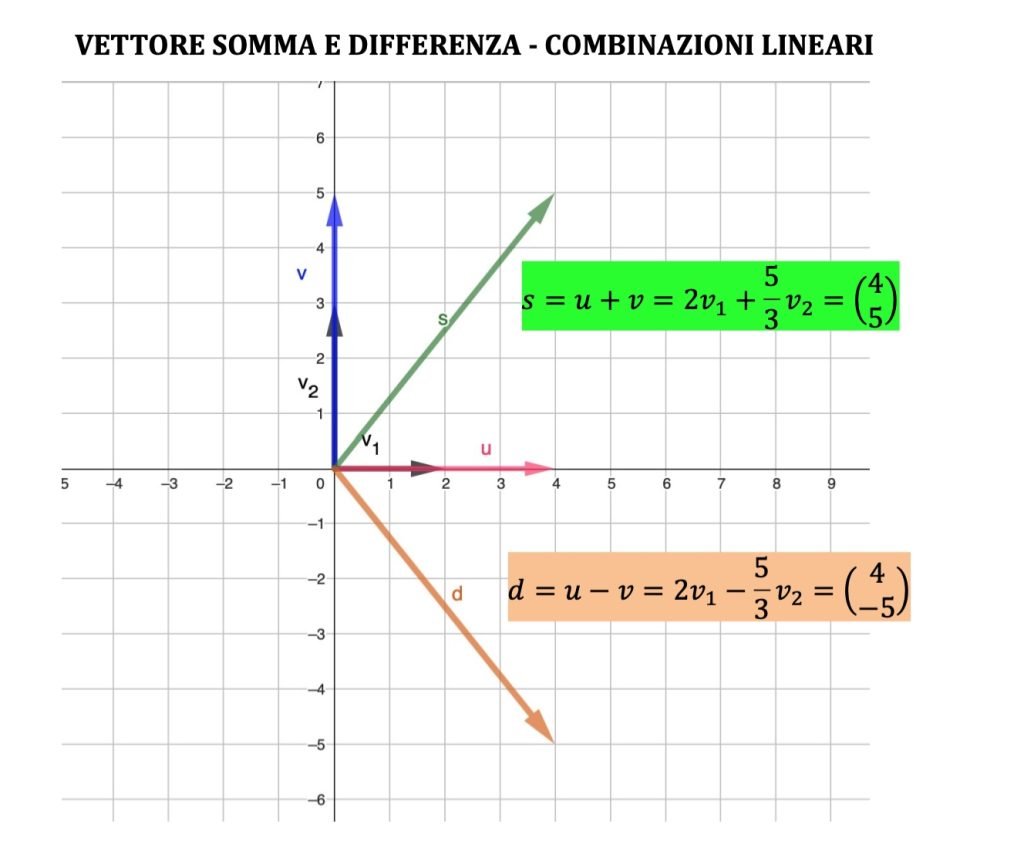

Ora possiamo fare una ulteriore combinazione lineare dei vettori u e v ad esempio facendo la loro somma s:

$$ s= u+v= 2v_1 + \frac{5}{3} v_2 = \begin{pmatrix} 4\\0 \end{pmatrix} + \begin{pmatrix} 0\\5 \end{pmatrix} = \begin{pmatrix} 4\\5 \end{pmatrix} $$

In questo caso s è combinazione lineare di vettori u e v, e dunque anche dei vettori v1 e v2.

Ma potremmo anche creare il vettore differenza:

$$ d= u-v= 2v_1 – \frac{5}{3} v_2 = \begin{pmatrix} 4\\0 \end{pmatrix} – \begin{pmatrix} 0\\5 \end{pmatrix} = \begin{pmatrix} 4\\-5 \end{pmatrix} $$

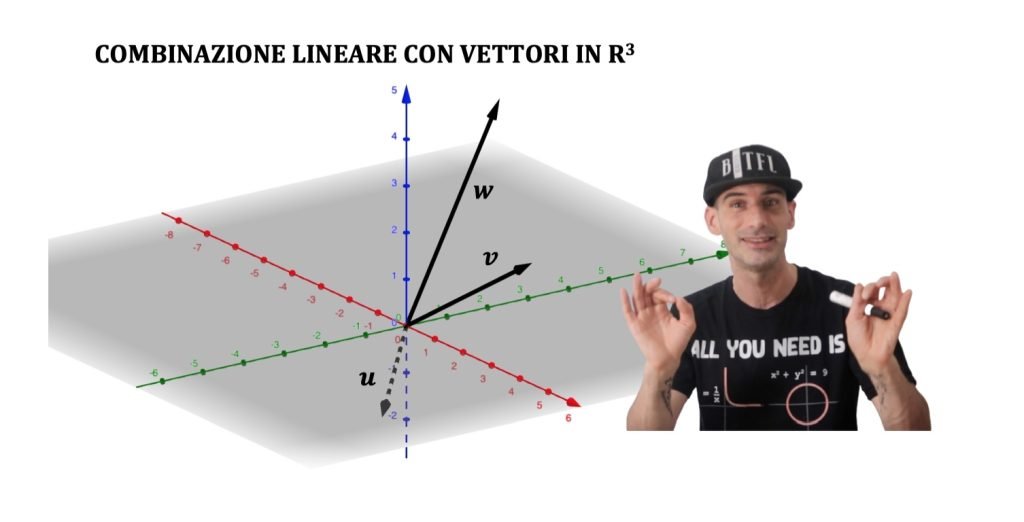

COMBINAZIONE LINEARE CON VETTORI IN R3

Consideriamo tre vettori con tre dimensioni quindi appartenenti allo spazio vettoriale R3 .

$$ v= \begin{pmatrix} 3\\1\\2 \end{pmatrix} \quad w= \begin{pmatrix} -1\\3\\4 \end{pmatrix} \quad u= \begin{pmatrix} 2\\-2\\-1 \end{pmatrix} $$

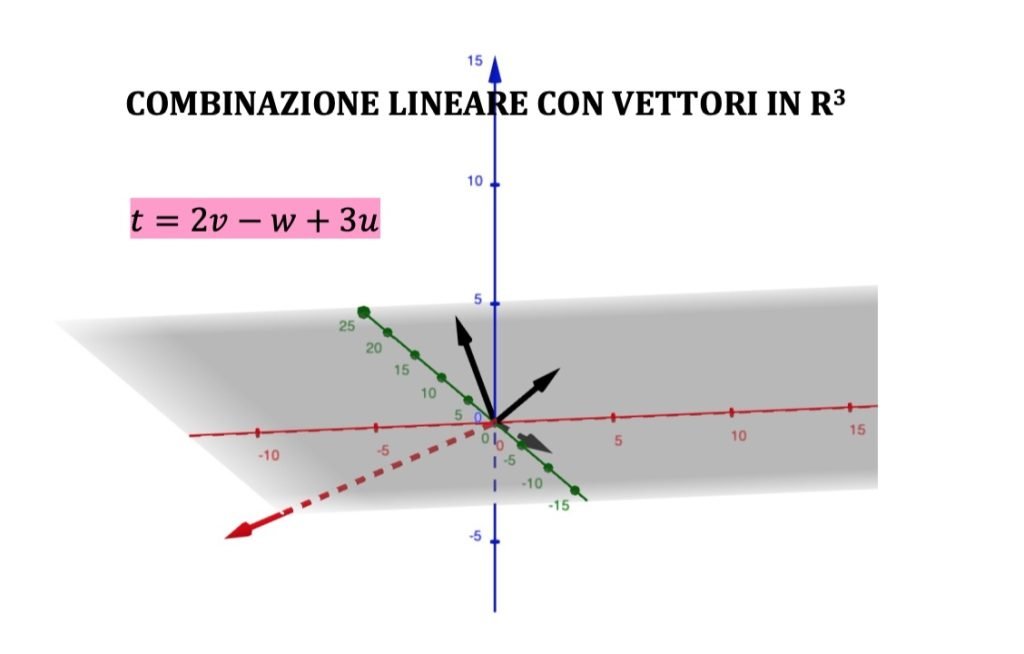

Ora creiamo una combinazione lineare del tipo:

$$ \begin{array}{l} t= 2v-w+3u \\ \ \\ t= 2 \begin{pmatrix}3\\1\\2 \end{pmatrix}-\begin{pmatrix} -1\\3\\4\end{pmatrix}+ 3 \begin{pmatrix}2\\-2\\-1 \end{pmatrix} \\ t= \begin{pmatrix}2 \cdot 3 -(-1)+3 \cdot 2 \\ 2 \cdot 1 -3 +3 \cdot (-2) \\ 2 \cdot 2 -4+3 \cdot (-1) \end{pmatrix} = \begin{pmatrix} 6+1+6 \\ 2-3-6 \\ 4-4-3 \end{pmatrix} = \begin{pmatrix} 13 \\ -7\\ -3 \end{pmatrix} \end{array} $$

COMBINAZIONI LINEARI IN Rn

Risulta subito chiaro che con la matematica non siamo più vincolati allo spazio ma possiamo rivolgersi ad un iperspazio dove lo spazio vettoriale ha un numero di elementi maggiore di 3.

Consideriamo ad esempio i due vettori di R4:

$$ v = \begin{pmatrix} 1\\2\\-3\\5 \end{pmatrix} \quad w= \begin{pmatrix} 2\\4\\5\\0 \end{pmatrix} $$

Creiamo il vettore a come una loro combinazione lineare:

$$ a= 2v-3w \\ \ \\ a= 2 \begin{pmatrix} 1\\2\\-3\\5 \end{pmatrix}-3 \begin{pmatrix} 2\\-4\\5\\0 \end{pmatrix} = \begin{pmatrix} -4\\16\\-21\\10 \end{pmatrix} $$

Il vettore a è combinazione lineare dei vettori v e w e risulta dunque linearmente dipendente da questi.

COMBINAZIONI LINEARI CON LE MATRICI

Vediamo ora un esempio di combinazione lineare con le matrici con un esempio molto semplice.

Consideriamo le due matrici 2×2 A e B:

$$ A = \begin{pmatrix} 2&1\\ 1&0 \end{pmatrix} \quad B= \begin{pmatrix} -1&3\\ 0&5 \end{pmatrix} $$

Creiamo ora la matrice C attraverso una combinazione lineare del tipo:

$$ C= -A+2B \\ \ \\ \begin{array}{l} C &= -\begin{pmatrix} 2&1\\ 1&0 \end{pmatrix}+2\begin{pmatrix} -1&3\\ 0&5 \end{pmatrix} \\ &= \begin{pmatrix}-2&-1 \\ 1&0 \end{pmatrix} + \begin{pmatrix} -2&6 \\ 0&10 \end{pmatrix} \\ &= \begin{pmatrix}-2-2 & -1+6 \\ 1+0 & 0+10 \end{pmatrix} \\ &= \begin{pmatrix} -4&5 \\ 1&10 \end{pmatrix} \end{array} $$

COMBINAZIONI LINEARI CON I POLINOMI

Le combinazioni lineari possono essere implementate anche con i polinomi.

Consideriamo i due polinomi in x che hanno grado massimo pari a 3, quindi li possiamo simboleggiare in questo modo:

$$ p_1(x) , p_2(x) \in \mathbb{R}_3 [x] : \\ \ \\ p_1(x) = 3x^3-x^2+2 \quad p_2(x)= 2x^2-x-5 $$

Scriviamo ora la seguente combinazione lineare che chiamiamo q(x):

$$ \begin{array}{l} q(x) &= 2p_1(x) +p_2(x) \\ &= 2(3x^3-x^2+2) +(2x^2-x-5) \\ &=6x^3-2x^2+4+2x^2-x-5 \\ &= 6x^3-x-1 \end{array} $$

Scrivendo in modo più elegante avremmo potuto fare:

$$ \begin{array}{l} q(x) &= 2p_1(x) +p_2(x) \\ &= 2(3x^3-x^2+2) +(2x^2-x-5) \\ &= (2 \cdot 3) x^3 +(-2+2)x^2-x+(4-5) \\ &= 6x^3-x-1 \end{array} $$

COME RICONOSCERE UNA COMBINAZIONE LINEARE ?

Se abbiamo tre vettori come facciamo a sapere se uno di questi può essere scritto come combinazione lineare degli altri due?

Consideriamo ad esempio i vettori a,b e c appartenenti ad R2:

$$ a = \begin{pmatrix} 1\\0 \end{pmatrix} \quad b= \begin{pmatrix} 0\\1 \end{pmatrix} \quad c = \begin{pmatrix} 2\\3 \end{pmatrix} $$

Qui risulta abbastanza evidente che il vettore c è ottenuto sommando al doppio del vettore a il triplo del vettore b, infatti:

$$ 2a+3b= 2 \cdot \begin{pmatrix} 1\\0 \end{pmatrix} + 3 \begin{pmatrix} 0\\1 \end{pmatrix} = \begin{pmatrix} 2\\3 \end{pmatrix} = c $$

Ma in generale non è così semplice accorgersi.

Consideriamo infatti i tre vettori t, u e v sempre di R2:

$$ t= \begin{pmatrix} 2\\-3 \end{pmatrix} \quad u= \begin{pmatrix} 3\\1 \end{pmatrix} \quad v= \begin{pmatrix} -2\\5 \end{pmatrix} $$

Cosa possiamo affermare?

In questo caso dobbiamo agganciarci ad un teorema dell’algebra lineare che afferma:

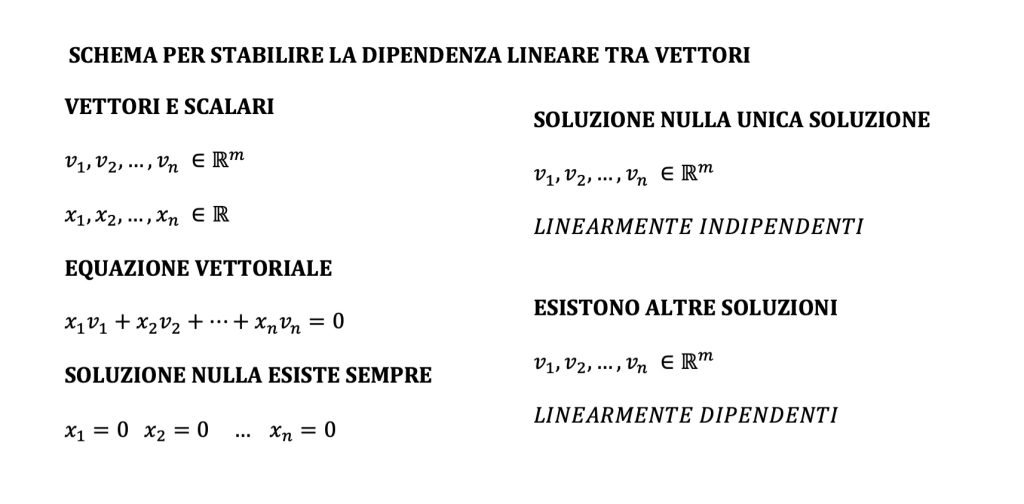

Consideriamo gli n vettori di dimensione m:

$$ v_1, v_2, \dots , v_n \in \mathbb{R^m} $$

e gli n scalari:

$$ x_1, x_2, \dots , x_n \in \mathbb{R} $$

Consideriamo ora l’equazione vettoriale:

$$ x_1v_1 + x_2v_2 + \cdots + x_n v_n = 0 $$

Con 0 che è il vettore nullo di dimensione m.

Immaginando che gli scalari sono incogniti e i vettori sono noti notiamo subito che una possibile soluzione è quella nulla.

$$ x_1=0 \quad x_2= 0 \quad \dots \quad x_n= 0 $$

Infatti risulta certamente verificata l’equazione:

$$ 0v_1 + 0v_2+ \cdots + 0v_n = 0 $$

Il teorema afferma che quando l’unica soluzione è quella nulla i vettori risultano tra di loro linearmente indipendenti.

Ovvero non possiamo riscrivere nessuno degli n vettori come una combinazione lineare degli altri n-1vettori.

Ma se oltre la soluzione nulla esiste almeno un’altra soluzione (di solito ve ne sono infinite) allora gli n vettori sono tra di loro linearmente dipendenti.

Ovvero possiamo riscrivere ciascuno degli n vettori come combinazione lineare degli altri n-1 vettori.

IMPARA L’ALGEBRA LINEARE

Impara l’algebra lineare con un percorso strutturato e facile da seguire passo a passo.

Un viaggio che parte dai vettori e dalle matrici, passando per i sitemi lineari giungerai nei meandri degli spazi vettoriali, della diagonalizzazione delle matrici con tappa finale nelle coniche.

STABILIRE LA DIPENDENZA – ESEMPIO

Ritorniamo per un momento alla questione precedente sui vettori:

$$ t= \begin{pmatrix} 2\\-3 \end{pmatrix} \quad u= \begin{pmatrix} 3\\1 \end{pmatrix} \quad v= \begin{pmatrix} -2\\5 \end{pmatrix} $$

Consideriamo l’equazione:

$$ xt+yu+zv=0 \quad \text{con }\ x,y,z \in \mathbb{R}\ \text{incogniti} $$

Esplicitiamola meglio in questo modo:

$$ x \begin{pmatrix} 2\\-3 \end{pmatrix} + y \begin{pmatrix} 3\\1 \end{pmatrix} + z \begin{pmatrix} -2\\5 \end{pmatrix} = \begin{pmatrix} 0\\0 \end{pmatrix} $$

Giungiamo presto al seguente sistema lineare, dove ogni equazione indica una componente del vettore somma:

$$ \begin{cases} 2x+3y-2z=0 \\ -3x+y+5z=0 \end{cases} $$

Esplicitiamo ora la y dalla seconda equazione poiché ci rendi i calcoli più semplici:

$$ \begin{cases} 2x+3y-2z=0 \\ -3x+y+5z=0 \end{cases} \begin{array}{l} \ \\ \to y= 3x-5z \end{array}$$

Per sostituzione la prima equazione diventa:

$$ \begin{array}{l} 2x+3(3x-5z)-2z=0 \\ 2x+9x-15z-2z=0 \\ 11x-17z= 0 \end{array} $$

Da che ricaviamo facilmente il valore della x in funzione della z:

$$ x= \frac{17}{11} z $$

A questo punto ritorniamo nella seconda equazione e sostituiamo:

$$ y= 3x-5z \overset{x= \frac{17}{11} z}{\longrightarrow} y= 3 \left( \frac{17}{11} z \right) -5z \\ \ \\ y= \frac{54}{11}z -5z = \frac{54-55}{11} z =\ -\frac{1}{11} z $$

Ecco che due delle tre incognite (x,y) risultano espresse in funzione della terza (z)

$$ \begin{cases} x= \frac{17}{11} z \\ y=\ -\frac{1}{11} z \end{cases} $$

Immaginando che le tre incognite formino un vettore:

$$ \begin{pmatrix} x\\ y\\ y \end{pmatrix} $$

possiamo scrivere:

$$ \begin{pmatrix} x\\ y\\ y \end{pmatrix} = \begin{pmatrix} \frac{17}{11} z \\ -\frac{1}{11} z \end{pmatrix} $$

Raccogliendo a fattor comune la variabile libera (incognita libera) z otteniamo:

$$ \begin{pmatrix} x\\ y\\ y \end{pmatrix} = \begin{pmatrix} \frac{17}{11} z \\ -\frac{1}{11} z \end{pmatrix} = z \begin{pmatrix} \frac{17}{11} \\ -\frac{1}{11} \\ 1 \end{pmatrix}$$

Da che si evince che la soluzione nulla esiste quando z è uguale a zero:

$$ z= 0 \to \begin{pmatrix} x\\ y\\ y \end{pmatrix} =\begin{pmatrix} 0\\0\\0 \end{pmatrix} $$

Ma ci sono altre infinite soluzioni, tanti quanti sono i valori reali della variabile z, ad esempio :

$$ \begin{array}{l} z= 1 &\to& \begin{pmatrix} x\\ y\\ y \end{pmatrix} = \begin{pmatrix} \frac{17}{11} \\ -\frac{1}{11} \\ 1 \end{pmatrix} \\ z= 2 &\to& \begin{pmatrix} x\\ y\\ y \end{pmatrix} = \begin{pmatrix} \frac{34}{11} \\ -\frac{2}{11} \\ 2 \end{pmatrix} \\ z= 3 &\to& \begin{pmatrix} x\\ y\\ y \end{pmatrix} = \begin{pmatrix} \frac{51}{11} \\ -\frac{3}{11} \\ 3 \end{pmatrix} \end{array} $$

e così via.

Esistendo infinite soluzioni affermiamo che i vettori sono linearmente dipendenti.

Ovvero possiamo riscrivere ognuno dei 3 vettori come combinazione lineare degli altri due.

Riprendiamo infatti l’equazione vettoriale di partenza:

$$ xt+yu+zv= 0 $$

Inseriamo una delle possibili soluzioni diversa da quella nulla:

$$ z= 1 \to \begin{pmatrix} x\\ y\\ y \end{pmatrix} = \begin{pmatrix} \frac{17}{11} \\ -\frac{1}{11} \end{pmatrix} $$

L’equazione diventa:

$$ \frac{17}{11} t – \frac{1}{11} u+v= 0 $$

Possiamo ricavare subito il vettore v come combinazione lineare di t e u:

$$ v = \ -\frac{17}{11} t + \frac{1}{11}u $$

Oppure ripartendo dall’inizio proviamo a ricavare il vettore t in funzione dei vettori u e v

$$ \begin{array}{l} \frac{17}{11} t – \frac{1}{11} u+v= 0 \\ 17t-u+11v=0 \\ 17t= u-11v = 0 \\ t= \frac{1}{17} u – \frac{11}{17} v \end{array} $$

Oppure ripartendo dal secondo passaggio possiamo ricavare il vettore u come combinazione lineare di t e v:

$$ u= 17t+11v $$

ESEMPIO DI VETTORI LINEARMENTE INDIPENDENTI

Consideriamo i tre vettori di R3:

$$ v= \begin{pmatrix} 1\\0\\-1 \end{pmatrix} \quad w= \begin{pmatrix} 2\\1\\3 \end{pmatrix} \quad \begin{pmatrix} -1\\1\\0 \end{pmatrix} $$

Impostiamo l’equazione vettoriale:

$$ x+2y-z=0 \\ \ \\ x\begin{pmatrix} 1\\0\\-1 \end{pmatrix} + y\begin{pmatrix} 2\\1\\3 \end{pmatrix} + z \begin{pmatrix} -1\\1\\0 \end{pmatrix} = \begin{pmatrix} 0\\0\\0 \end{pmatrix} $$

che ci porta al sistema lineare:

$$ \begin{cases} x+2y-z=0 \\ y+z=0 \\ -x+3y=0 \end{cases}$$

Dalla seconda e dalla terza equazione ricaviamo il valore della z e della x in funzione di y

$$ \begin{cases} x+2y-z=0 \\ y+z=0 \\ -x+3y=0 \end{cases} \to \begin{cases} x+2y-z=0 \\ z=-y \\ x= \frac{1}{3} y \end{cases}$$

Sostituiamo questi valori nella prima equazione di modo da avere solo la y:

$$ x+2y-z= 0 \overset{\begin{cases} z=-y \\ x= \frac{1}{3} y \end{cases}}{\longrightarrow} \frac{1}{3}y+2y+y=0 \\ \ \\ y+6y+3y=0 \to 10y=0 \to y=0 $$

Dunque risostituendo notiamo che l’unica soluzione ammissibile è quella nulla:

$$ \begin{cases} x=0 \\ y=0 \\ z= 0 \end{cases} $$

Dunque affermiamo che i vettori risultano linearmente indipendenti.

Ovvero non possiamo scrivere nessuno dei tre vettori come combinazione lineare degli altri due vettori.

STUDIO DELLA DIPENDENZA LINEARE CON IL RANGO

Lo studio del rango della matrice ci offre una scorciatoia per analizzare la dipendenza o l’indipendenza lineare dei vettori.

Ricordiamo che il rango o caratteristica di una matrice indica il numero di vettori riga (colonna) che sono linearmente indipendenti.

Quando il rango è uguale al numero di vettori considerati allora concludiamo che i vettori sono linearmente indipendenti.

Mentre quando il rango è inferiore al numero di vettori considerati diciamo che i vettori linearmente dipendenti.

Dunque in questo caso ogni vettore può essere riscritto come combinazione lineare degli altri vettori.

VETTORI LINEARMENTE DIPENDENTI CON IL RANGO – ESEMPIO 1

Proviamo ad analizzare i casi visti in precedenza.

Partiamo dai vettori t, u e v:

$$ t= \begin{pmatrix} 2\\-3 \end{pmatrix} \quad u= \begin{pmatrix} 3\\1 \end{pmatrix} \quad v= \begin{pmatrix} -2\\5 \end{pmatrix} $$

Costruiamo la matrice A 2×3 con i vettori scritti in colonna:

$$ A = \begin{pmatrix} 2&3&-2 \\ -3&1&5 \end{pmatrix} $$

Le due righe della matrice sono certamente indipendenti poiché non sono multiple.

Concludiamo dunque che il rango della matrice vale 2.

Per questo motivo solamente due dei tre vettori risultano linearmente indipendenti.

Se ci chiediamo quali in realtà non esiste una sola risposta.

Infatti se consideriamo le coppie di vettori:

$$ (t,u) \quad (t,v) \quad (u,v) $$

Sono certamente indipendenti in quanto non sono vettori multipli.

Comunque sia siccome il rango è inferiore al numero di vettori allora esiste una dipendenza lineare tra questi.

VETTORI LINEARMENTE INDIPENDENTI CON IL RANGO – ESEMPIO 2

Consideriamo il secondo caso analizzato prima con i vettori v, w e t di R3:

$$ v= \begin{pmatrix} 1\\0\\-1 \end{pmatrix} \quad w= \begin{pmatrix} 2\\1\\3 \end{pmatrix} \quad \begin{pmatrix} -1\\1\\0 \end{pmatrix} $$

Mettiamoli insieme nella matrice M 3×3 in colonna:

$$ M= \begin{pmatrix} 1&2&-1 \\ 0&1&1 \\ -1&3&0 \end{pmatrix} $$

Studiamo il determinante della matrice M con il metodo di Laplace scegliendo ad esempio la seconda colonna:

$$ \begin{array}{l} \det M &= 1 \cdot \left| \begin{array}{c} 1&-1 \\ -1&0 \end{array} \right| – 1 \cdot \left| \begin{array}{c} 1&2 \\ -1&3 \end{array} \right| \\ &= 1 \cdot(0-1) -1 \cdot (3+2) \\ &= -1-5= -6 \ne 0 \end{array} $$

Essendo il determinante del minore di ordine massimo diverso da zero concludiamo che il rango della matrice vale 3.

Questo significa che tutti e 3 i vettori sono linearmente dipendenti.

HAI QUALCHE DOMANDA ?

Se questo articolo ti ha fatto venire qualche domanda scrivila nei commenti.

SCOPRI I SEGRETI DELL’ALGEBRA LINEARE

Impara l’algebra lineare con un percorso strutturato e facile da seguire passo a passo.

Un viaggio che parte dai vettori e dalle matrici, passando per i sitemi lineari giungerai nei meandri degli spazi vettoriali, della diagonalizzazione delle matrici con tappa finale nelle coniche.

L’ARTICOLO TI è PIACIUTO ?

Se questo contenuto ti è piaciuto e vorresti che anche altri utenti possano goderne di questo ed altri ancora sostieni il progetto offrendomi un semplice caffè virtuale

Questo semplice gesto per me significa moltissimo e può essere un forte impulso per lo sviluppo di tutto il progetto di divulgazione matematica

Visita il canale YouTube!